Brojne kompanije uključujući Microsoft і Facebook, pa čak i istraživači sa Univerziteta Južne Kalifornije, razvijaju tehnologije za borbu protiv deepfakesa i sprječavaju njihovo širenje žutim medijima i dezinformacijama općenito. Međutim, grupa naučnika ih je ipak uspjela prevariti.

Tim kompjuterskih naučnika sa Univerziteta u Kaliforniji u San Dijegu upozorio je da je i dalje moguće prevariti postojeće sisteme za detekciju dubokih lažiranja umetanjem ulaznih podataka koji se nazivaju "konkurentski primjeri" u svaki video okvir. Naučnici su predstavili svoja otkrića na WACV 2021 Computer Vision konferenciji, održanoj onlajn prošlog mjeseca.

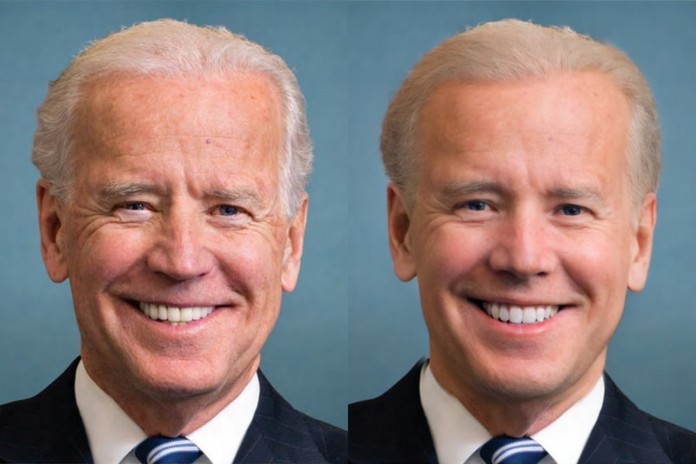

Konkurentni primjeri su neznatno izmijenjeni ulazi koji uzrokuju greške u sistemima umjetne inteligencije, kao što su modeli strojnog učenja. Osim toga, tim je pokazao da napad i dalje radi nakon kompresije videa. U videu iznad, naučnici pokazuju da XceptionNet, deepfake detektor, označava njihov konkurentski video kao "pravi".

Većina ovih detektora radi tako što prate lica u videu i šalju izrezane podatke o licu neuronskoj mreži na analizu. Neuronska mreža će zatim analizirati ove podatke i pronaći elemente koji se obično loše reproduciraju u dubokim lažnjacima, kao što je treperenje.

Umetanjem konkurentskih primjera, istraživači su otkrili da bi mogli prevariti ove detektore dubokog lažiranja da povjeruju da su video snimci stvarni.

U radu navode da je „kako bi se ovi detektori deepfake koristili u praksi, važno ih procijeniti u odnosu na prilagodljivog protivnika koji je svjestan ove zaštite i namjerno je pokušava razbiti. Pokazujemo da se moderne metode detekcije dubokog lažiranja mogu lako zaobići ako je napadač potpuno ili čak djelimično svjestan detektora."

Kao što su ovi naučnici pokazali, tehnologije automatizacije koje se razvijaju za borbu protiv dezinformacija možda još nisu na visini zadatka.

Pročitajte također: